普段はお菓子食べたり,しゃべってたり,ゲームしたりもしてますが,こんな研究をしています.

Projectsページでも研究内容を紹介しています.そちらもぜひチェックしてください!

出来て間もない研究室なので,先輩の研究を引き継ぐ形にはなりにくいです.

逆に言えば,自分がやってみたい!と思ったことに挑戦できます.アイデアを思いついたらどんどん先生や先輩と相談してみよう!

装着型表情認識技術AffectiveWear (2015-)

カメラが得意ではない環境においても利用可能な、光センサを用いた表情認識研究をしています.

日常において表情を検出することでその人の状態把握に役立てたり、没入型HMDに埋め込み、アバターに自分の表情を反映させることで、没入感のあるコンテンツ製作に役立てたりできるシステムの研究開発をしています.

関連記事:[SIGGRAPH 2015]触覚フィードバックや表情認識機能付きHMDなど,ちょっと変わった最新技術が展示されたEmerging Technologiesレポート, 4gamer.net, Aetas, 2015.8.24

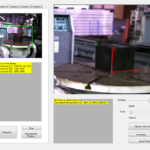

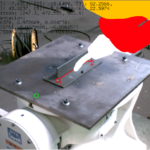

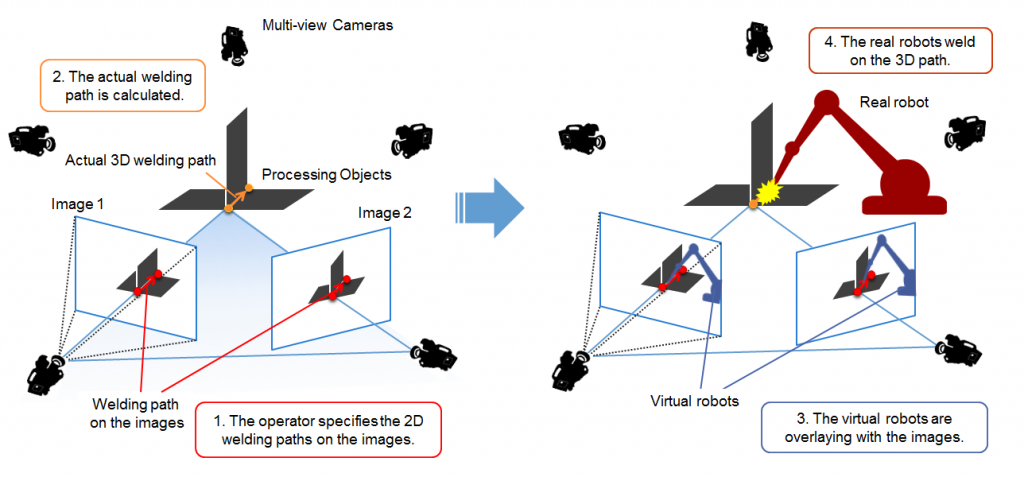

多視点映像を用いた溶接ロボットの遠隔操作システム (2015-)

熟練した技術を必要とするロボットを用いた溶接加工を、溶接に慣れていないユーザでも直感的に、しかも遠隔で行えるようにするためのシステムを開発しています。斎藤(英)研およびロボットシステムメーカーとの協同プロジェクト。

ユーザは複数のカメラ映像を見ながら、加工経路をカメラ画像上で指定します。これにより、溶接の3次元経路が計算され、3次元空間内でのロボットの動きを決定します。

このとき,計算された3次元経路をロボットが実際になぞった様子をシミュレートした3DCGアニメーションを生成し、各カメラの映像に重畳することで、実ロボットを動かさずに、ロボットの動作を確認することができます。

このシステムを使うと、従来のコントローラや専用ソフトを用いた操作に対して、「映像を見て加工経路をなぞるだけ!」というシンプルな操作で溶接ロボットを動かすことができます!7月には開発したシステムを用いて、実際にロボットを動かし溶接も行いました。

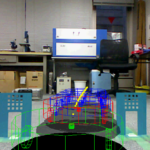

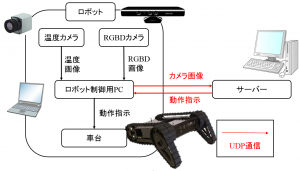

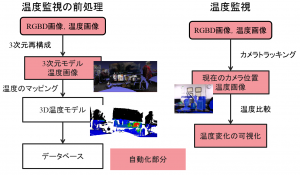

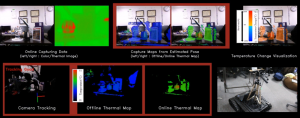

温度監視のための自律制御ロボットによる3次元温度モデルの作成 (2015-)

このシステムは温度カメラを自律制御ロボットに搭載し広範囲の温度監視を行うための研究です.

RGB-Dカメラと温度カメラを用いて実空間の3次元情報を復元,平常時の3D温度モデルを作成し,現在の温度カメラの値との差分を取ることで,温度変化を可視化しAR表示を行います.

3次元形状の復元は距離の自動調整や復元の精度を評価することにより密な3Dモデルの作成を目指しています.

前庭感覚電気刺激(GVS: Galvanic Vestibular Stimulation) (2015-)

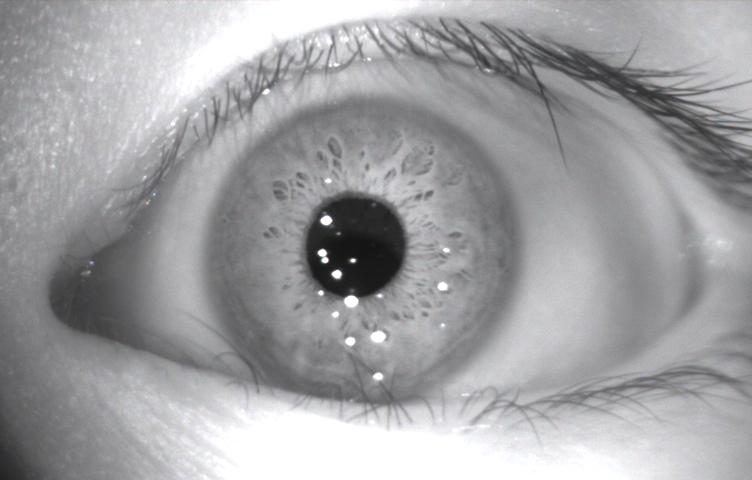

前庭感覚電気刺激(GVS)とは,人間の重力や加速度を司る感覚である前庭感覚に対して電気刺激を行い加速度感覚を提示する方法である.GVSを行う場合において,前庭器官への刺激から前庭動眼反射(VOR: Vestibulo-Ocular Reflex)の生起が確認されており,主として回旋性眼球運動が誘発されている.

現在,姿勢を変更して重力の方向と前庭感覚を提示する方向がGVSによる回旋性眼球運動へ与える影響についての研究を行っている.

ベイジアンネットと全周囲パノラマ画像を用いた家電の操作支援システム (2014-)

スマートフォンやタブレットといった携帯端末上に360°全周囲を撮影した写真を表示し,ユーザの家電操作を支援するシステムを開発しています.

↑ 全周囲パノラマ画像の例 (画面内を操作して見回せます)

全周囲パノラマ画像に映っている家電を極座標系で捉えることで,位置や領域を一意に決定することができます.

また,ベイジアンネットを用いて,現環境や過去の家電選択情報から,次に操作する家電の予測を行う研究も行っています.

重心移動によってバーチャル物体の内容量を提示する把持型触覚デバイス (2014-)

人間の知覚を利用した触覚の VR システムです.

内部の重心位置を変え,バーチャル物体の内容量を提示するペットボトル型の触覚デバイスです.

重心が変わると把持位置回りの回転モーメントが変わるので,結果として,擬似的な振りの重さを感じることができます.

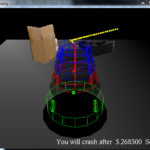

未来の状態を可視化してロボットの操作を行うインタフェース (2013-)

ロボットの遠隔操作をより操作しやすく,より安全に進んでもらおうという研究.

ここでは,ロボットが現在の操作を続けた場合,この後ロボットがどうなってしまうのか?ということを可視化することで,操作者がより安全に目的地へ進めるような研究を行っています.

見せている画像は未来のロボットの予測軌跡を表しており,これは物理シミュレーションを行ったためガコンとぶつかった結果を見せることができます.

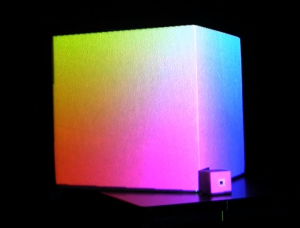

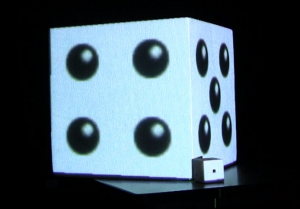

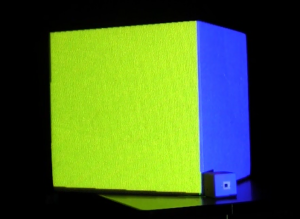

輝度勾配画像による面型光センサの3次元位置計測 (2013-)

光センサの3次元の位置を計測をすることによって,プロジェクションマッピングを効率化していく研究です.

これがうまくいくと,こんな風に簡単に立方体に様々なプロジェクションマッピングをすることができます.

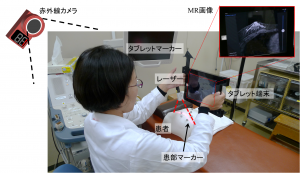

タブレット端末を用いて患部に対応したMRI画像提示するインタフェース (2013-)

医療用画像(MRI画像やCT画像など)を実際と患部と対応付けて提示することで、医師が癌などの病変位置を把握するのを助けるための研究です.

医師は下図のようにタブレット端末を操作し,端末から照射されるレーザー光の当たっている位置のMRI画像を表示します.タブレット端末の向きや位置を変えることで、その向きに応じて任意のMRI画像を見ることができます.

このプロジェクトは,現在,慶應義塾大学医学部の乳腺外科と共同研究を行っています.

Kinectを使った物体の三次元形状の再構築 (2012-)

Kinectは,RGB画像(普通のカメラ画像)とDepth画像(奥行き情報)を取得することができるが,物体の表面の情報しかとれないという問題があります.

そこで,物体を手で回し,物体の表面の情報を統合することによって,三次元形状の再構築を行います.

この際,手が映り込んだりしてしまうが,この研究では手の除去を行っています.

これによって,形状が未知のオブジェクトの情報をコンピュータにとりこむことができます.

距離画像に基づく表面形状の追従計測 (2012-)

プロジェクタなどを利用した空間型拡張現実感環境を前提として、マーカーレスでの実物体の位置・姿勢の追従計測を行う研究です.

距離画像に基づいたトラッキングを行うことにより,照明環境の変化にも頑強なシステム構成を実現しています.

身の回りのオブジェクトにいろいろな色やテクスチャをつけられるような環境を構築中.

Kinectを使った遠隔コミュニケーション (2012-)

Kinectを2つ使った遠隔コミュニケーション.

クライアント側(Kinect)でそれぞれ撮った画像をサーバーで統合し,互いにインタラクションできるようにする.現在,物理シミュレーション機能などを実装中.

いまのところ,ダンスの遠隔指導アプリケーションだったり,ボールゲームだったり,相撲ができたり,なんと遠隔地同士での漫才も可能だったり.

研究室年間日程

> 杉本研究室の研究

杉本研究室にあるもの

杉本研究室の日常

For B3 トップへ